Remarque : les experts sont très loin d’être d’accord sur les différentes définitions, et encore plus sur les possibilités d’arriver à ces différentes intelligences artificielles.

Définissons tout de même chacune d’elle :

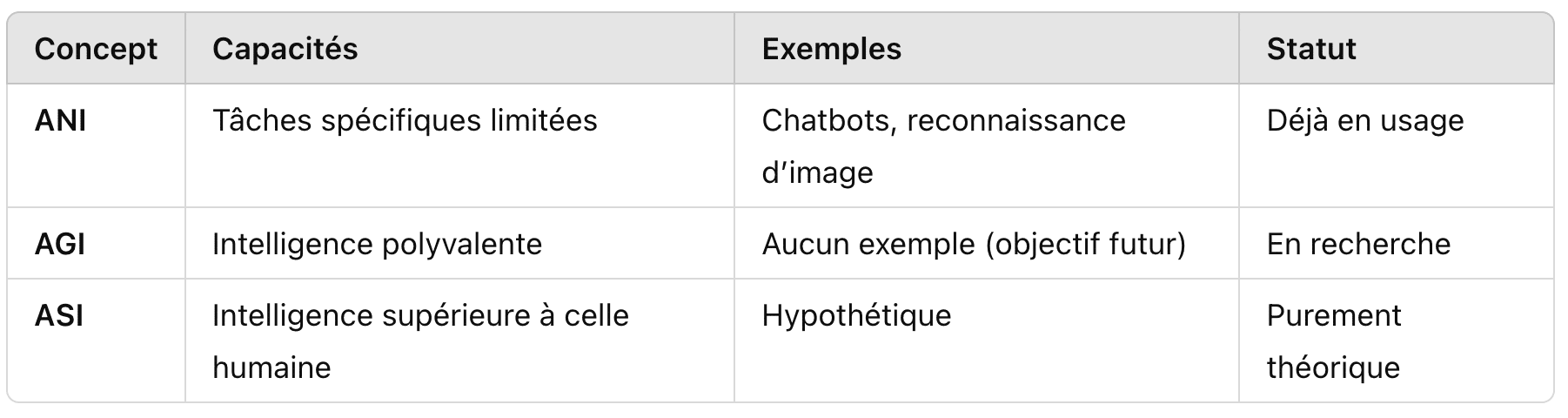

ANI (Artificial Narrow Intelligence) ou « IA étroite » ou « IA faible ».

L’ANI désigne des systèmes d’intelligence artificielle conçus pour accomplir une tâche ou un ensemble limité de tâches spécifiques. Ces systèmes n’ont pas de compréhension générale ou d’intelligence au sens humain.

Ce sont par exemple les assistants vocaux comme Siri ou Alexa, les algorithmes de recommandation sur Netflix ou YouTube, les modèles de traitement d’images, comme ceux utilisés pour la reconnaissance faciale et bien sûr, les ChatBots type ChatGPT, Gemini ou Grok.

AGI (Artificial General Intelligence) ou « IA générale »

L’AGI correspondrait à une intelligence artificielle qui serait capable de comprendre, d’apprendre et de résoudre n’importe quelle tâche intellectuelle qu’un être humain peut accomplir en imitant les capacités cognitives humaines de manière polyvalente.

Elle serait également caractérisée par la capacité d’apprendre de matière autonome dans plusieurs domaines et à s’adapter à des environnements inconnus ou à des problèmes imprévus.

Attention : l’AGI reste hypothétique et n’a pas encore été développée, bien que des recherches avancées s’y consacrent avec des moyens financiers considérables.

Remarque : le QI estimé sur la base de Codeforces Rating pour Open AI o3 est de 157 ! (Chatgpt 4o serait à 115), quand la moyenne du QI humain serait de 100.

ASI (Artificial Superintelligence) ou « IA superintelligente »

Là aussi, utilisons le conditionnel puisque c’est purement hypothétique.

L’ASI désignerait une intelligence artificielle qui surpasserait de loin les capacités humaines dans tous les domaines, y compris les capacités créatives, la prise de décision, et les compétences émotionnelles ou sociales.

Elle permettrait la résolution de problèmes complexes à une échelle inatteignable pour l’humanité.

Mais également des risques importants si elle n’est pas contrôlée, comme des impacts imprévus sur la société et l’environnement. Et problème d’alignement (que les comportements soient en adéquation avec les intentions, valeurs et attentes humaines)

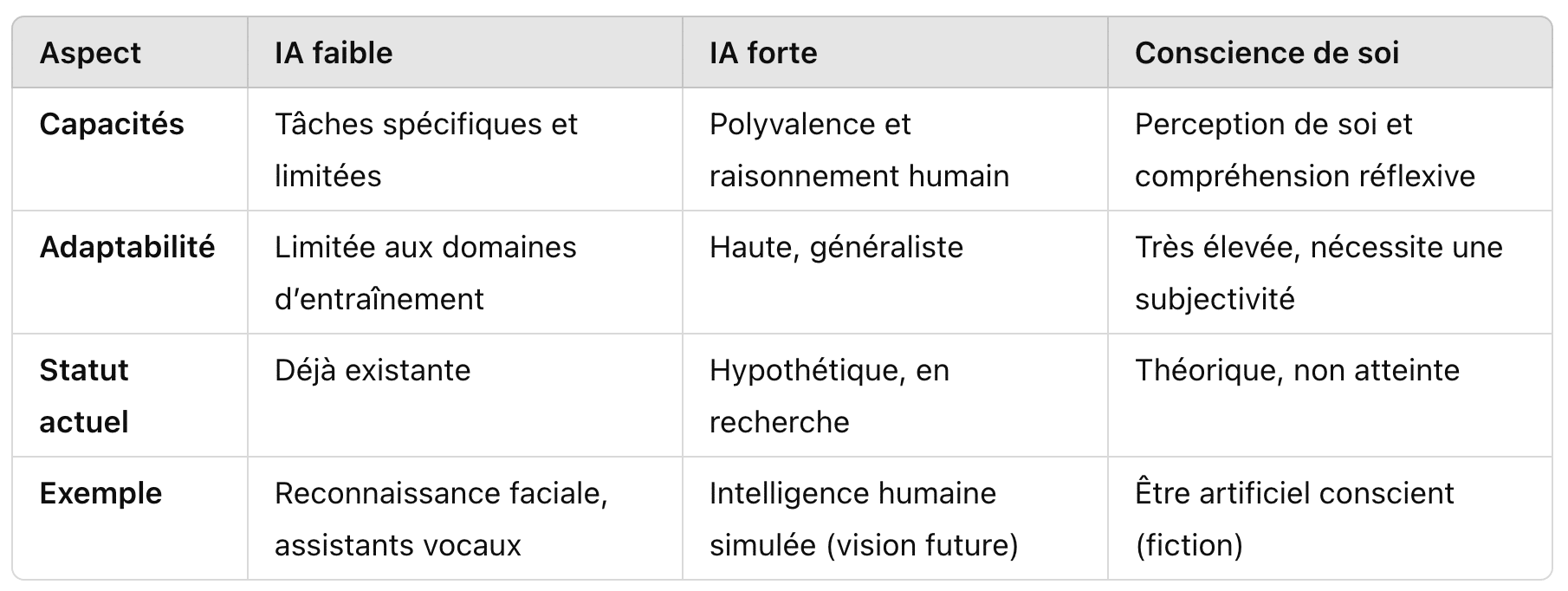

Confusion entre IA forte et IA qui aurait conscience d’elle-même :

Certains spécialistes revendiquent l’IA forte dès le stade de l’AGI. D’autres au stade de l’ASI. Et ces mêmes experts prophétisent parfois la conscience de soi pour ces deux stades d’IA. Pour autant, IA forte ne signifie pas nécessairement conscience de soi.

La conscience de soi implique qu’un système d’IA aurait une perception de sa propre existence, de son état interne et de son interaction avec le monde extérieur, semblable à la conscience humaine. A mon sens, une superintelligence pourrait exister éventuellement sans conscience d’elle-même.

Étapes vers la conscience de soi :

1-Perception de soi minimale : Connaissance de son propre « corps » ou fonctionnement (exemple : un robot sait que son bras bouge).

2-Théorie de l’esprit : Capacité de comprendre que d’autres entités ont des pensées et intentions distinctes.

3-Conscience réflexive : Compréhension approfondie de soi-même, de son rôle dans le monde, et capacité d’autoréflexion.

Aucune IA n’est actuellement consciente d’elle-même. Les systèmes d’IA actuels simulent des réponses basées sur des données, mais n’ont pas de subjectivité ou d’intentionnalité. Même si des recherches explorent la possibilité de développer une « IA consciente », cela reste hautement spéculatif et controversé, certains spécialistes jugent même cela impossible.

Enjeux de la conscience en IA

A partir du moment où une IA aurait conscience d’elle-même tout est possible : hostilité, agenda différent des Hommes, bienveillance ?

Personne n’en sait rien.

Ce qui est sûr si l’on y parvient, c’est que des questions vertigineuses se poseraient :

– Doit-on accorder des droits à une IA consciente ?

– Quelles responsabilités pour les créateurs ?

– Peut-on réellement simuler ou créer une conscience sans comprendre totalement celle des humains ?

– Le cerveau humain ne serait-il finalement qu’un algorithme ?

– Doit-on considérer l’IA comme un être supérieur et lui laisser décider pour nous ?

…

Evidemment, nous sommes abreuvés de films de science-fictions qui évoquent souvent les scénarios du pire.

En réalité, ce sont des réflexions très anthropomorphiques. Nous aimons aussi beaucoup jouer à nous faire peur. Mais qu’en serait-il vraiment ? Nous n’en n’avons aucune idée.

Jérôme COUTOU • Associé – Directeur Développement • +33(0)6 85 75 38 09